Conférence de Gérald Bronner - Développer son esprit critique face à la désinformation (1 & 2)

En ces temps troublés et un peu anxiogènes (changement climatique, guerres, etc), il me semble important de bien savoir s’informer, discuter.

Essayer d’être un meilleur citoyen, et moins un consommateur.

Pour m’aider dans cette démarche, je creuse différentes sources sur l’esprit critique.

On m’a recommandé les conférences de Gérald Bronner à la Sorbonne qu’il a organisé dans le cadre d’une université populaire.

Et si sur la page Wikipedia on trouve des controverses sur le personnage, globalement je ne vois pas de red flag.

Le visionnage des deux premiers volets de ce cycle m’a conforté dans mon choix.

C’est très intéressant, et en plus très bien expliqué.

Voici donc mes notes des deux premières conférences.

Première conférence

Le problème : le risque de désinformation

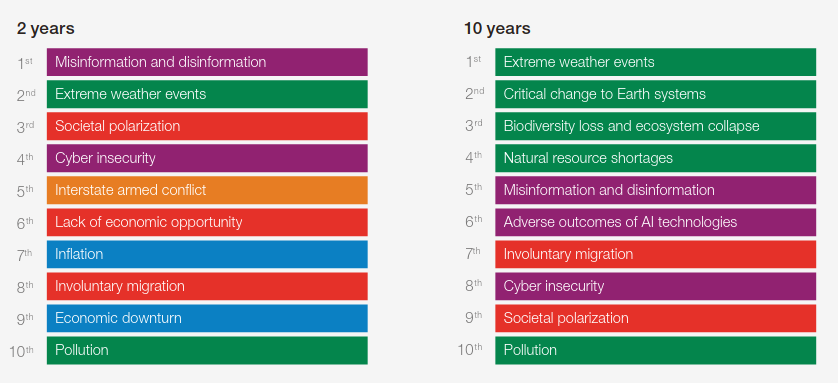

Le danger de croyance. A court terme, ce point est remonté par un panel de 1500 experts comme étant le plus grand danger qui pèse sur l’humanité. Plus que le réchauffement climatique (Source : Global Risk Forum).

A l’origine de ce problème : le volume d’information, l’infobésité. Plus il y a d’informations

- plus il y a de pression concurrentielle sur le marché des idées,

- plus il y a de chance que j’accède à une information qui va dans le sens de ce que je veux penser, de mes convictions personnelles.

Le rôle des réseaux sociaux

Et tout le monde peut intervenir, dire son mot. Certains interviennent plus que d’autres. 1% des comptes sur les réseaux sociaux sont à l’origine de 33% de l’information. Et les plus actifs sont les plus radicaux. Qui peuvent être très agressifs.

Il a noté que la vitesse de diffusion d’une fake news avait nettement accélérée ces derniers temps. Pour la mort de Kennedy, il a fallu 27 jours avant de voir la première théorie du complot apparaître. Idem pour le 11 septembre 2001. Pour les attentats de Charlie Hebdo, en 2015, il n’a fallu que quelques heures.

Il ne faut pas sous estimer la puissance argumentaire des théories complotistes. Si on n’est pas préparé, on peut se faire démonter. Dans la masse d’arguments, certains peuvent semer le doute. C’est une certaine forme d’intimidation intellectuelle. Les personnes modérées et/ou moins préparées n’osent pas forcément intervenir. Cela laisse la place à ces personnes, qui sont souvent très motivées (auparavant certaines d’entre elles s’estimaient être censurées, maintenant rien ne les arrête). Et il y a la loi de Brandolini : il faut beaucoup moins de temps pour répandre une information fausse qu’il ne faut pour rétablir la vérité, la défaire. Réfuter, c’est coûteux. Le faux se diffuse mieux.

Que pouvons nous faire aujourd’hui ?

Pour lui, c’est au niveau individuel uniquement qu’il reste une marge de manœuvre (arf).

- On ne partage pas de la désinformation.

- Ce qui prédit le plus la crédulité c’est la paresse intellectuelle (ou avarice cognitive). On ne cherche pas l’optimalité, on se contente du vraisemblable. Et autant on ne peut pas toujours être dans l’analyse (on serait épuisé), autant il faut savoir activer ce mode quand il le faut. Il faut apprendre à reconnaitre les situations typiques (biais cognitifs) où cela vaut le coup de faire un effort. Savoir identifier les biais.

Est-ce que notre civilisation va durer ?

Il parle de l’historien Tainter, sur la chute des civilisations. Une civilisation finit par s’écrouler quand la complexité de sa gestion excède les avantages de cette complexité. Je cite Wikipedia :

la durabilité ou l’effondrement des sociétés a pour origine le succès ou l’échec des institutions qu’elles avaient chargées de résoudre les problèmes rencontrés ; les sociétés s’effondrent lorsque leurs investissements dans la complexité sociale et leurs « subsides en énergie » atteignent un point au-delà duquel le retour marginal sur investissement diminue.

Deuxième conférence

Importance de la confiance dans l’information

Il nous est impossible de tout connaître. Cela est même de plus en plus difficile, il y a de plus en plus de connaissances, d’informations. Nous devons croire par délégation (à la science, aux institutions). La dérégulation du marché de l’information, la surinformation et infobésité menacent ce mécanisme de confiance. Il y a de la défiance dans les sciences et les institutions maintenant. Et les réseaux sociaux amplifient cette défiance en augmentant le volume de désinformation (et en jouant sur nos biais).

Limites de la rationalité humaine

Il identifie 4 limites :

- Limites spatiales (ce que nous percevons est une hallucination contrôlée). Nous ne percevons qu’une certaine partie de la réalité (nous ne percevons pas les infrarouges, certaines fréquences, etc).

- Limites temporelles. Nous ne vivons qu’au présent. Le passé est reconstitué, le futur inconnu. Spontanément nous anticipons par prédiction à l’identique (demain ressemblera à aujourd’hui). Il donne l’exemple de la dinde inductiviste de Bertrand Russel. La dinde voit arriver le fermier tous les jours avec des graines, et s’imagine que cela se passera toujours ainsi. Le 24 décembre, elle ne s’attend pas à le voir débarquer pour servir de repas et mettre à mal son raisonnement inductif. Nous sommes souvent comme la dinde. Incapables d’anticiper des changements brutaux ou exponentiels.

- Limites culturelles (cadre interprétatif dû à notre milieu social, notre environnement culturel, etc)

- Les limites cognitives (nos biais cognitifs). L’exemple du problème de Monty Hall est assez fou, je vous invite a aller le voir, le cerveau résiste fort à le croire (en tout cas chez moi).

Les conséquences des limites de la rationalité humaine

Elles expliquent la montée de la défiance envers les institutions et la science. Elles alimentent les bulles cognitives et la polarisation politique, particulièrement sur les réseaux sociaux. Elles favorisent la diffusion des croyances infondées, du complotisme et de la désinformation. Elles fragilisent la capacité collective à réagir rationnellement aux crises (sanitaires, économiques, politiques).

Des solutions

Dans la première conférence il conseillait de savoir lutter contre une certaine paresse intellectuelle. Savoir activer une réflexion quand il le faut. Il précise dans cette conférence :

- apprendre à reconnaître ses biais

- diversifier ses sources

- suspendre son jugement (prendre du recul)

- cultiver la confiance rationnelle dans les institutions scientifiques

Si ces notes vous ont intéressé, on se retrouve bientôt pour la suite.

J’apprécie aussi sur le sujet :

- La chaîne Hygiène Mentale. Le contenu est de très grande qualité, le ton très pédagogique.

- Le livre The Scout Mindset de Julia Galef dont j’ai déjà parlé ici.

Editions :

- 21/08/25 : ajout de la source du Global Risk Forum